The MCP Hub:为碎片化的 AI 工具链构建统一控制平面

I. 引言:AI 时代的"配置地狱"

作为一名全栈开发者,你的早晨可能是这样开始的:

你在 Cursor 里写代码,突然需要查询生产环境的数据库结构。你熟练地打开 Cursor Settings,在 MCP 选项卡里点击 "Add new global MCP server",填入名字和连接命令:npx -y @modelcontextprotocol/server-postgres postgres://...。搞定,Cursor 顺利读到了 Schema。

下午,你切换到终端,想用 Gemini CLI 做一些批量数据处理。你输入 gemini "查询数据库中最近 10 条订单详情",结果模型尴尬地回答:I don't have access to your database...。

你拍了拍脑门,发现忘记在 CLI 里配置 MCP 了。于是你打开 ~/.gemini/settings.json,把早上的 Postgres 配置又复制粘贴了一遍。

晚上,你试用了一下 Claude Code。不出所料,为了让它也能连上数据库,你得去 ~/.claude.json 再来一次...

这就是 AI 辅助开发领域的现状 —— Configuration Hell(配置地狱)。

MCP (Model Context Protocol) 确实解决了一个伟大的问题:它标准化了 AI 连接数据的协议。但它引入了一个新的噩梦:配置的碎片化。每个 AI 工具(Client)都把自己当成世界的中心,都有自己的一套配置文件、一套权限管理、一套日志系统。

我们正在重蹈微服务早期的覆辙 —— 有了通用的 HTTP 协议,却缺少了一个统一的 Hub。

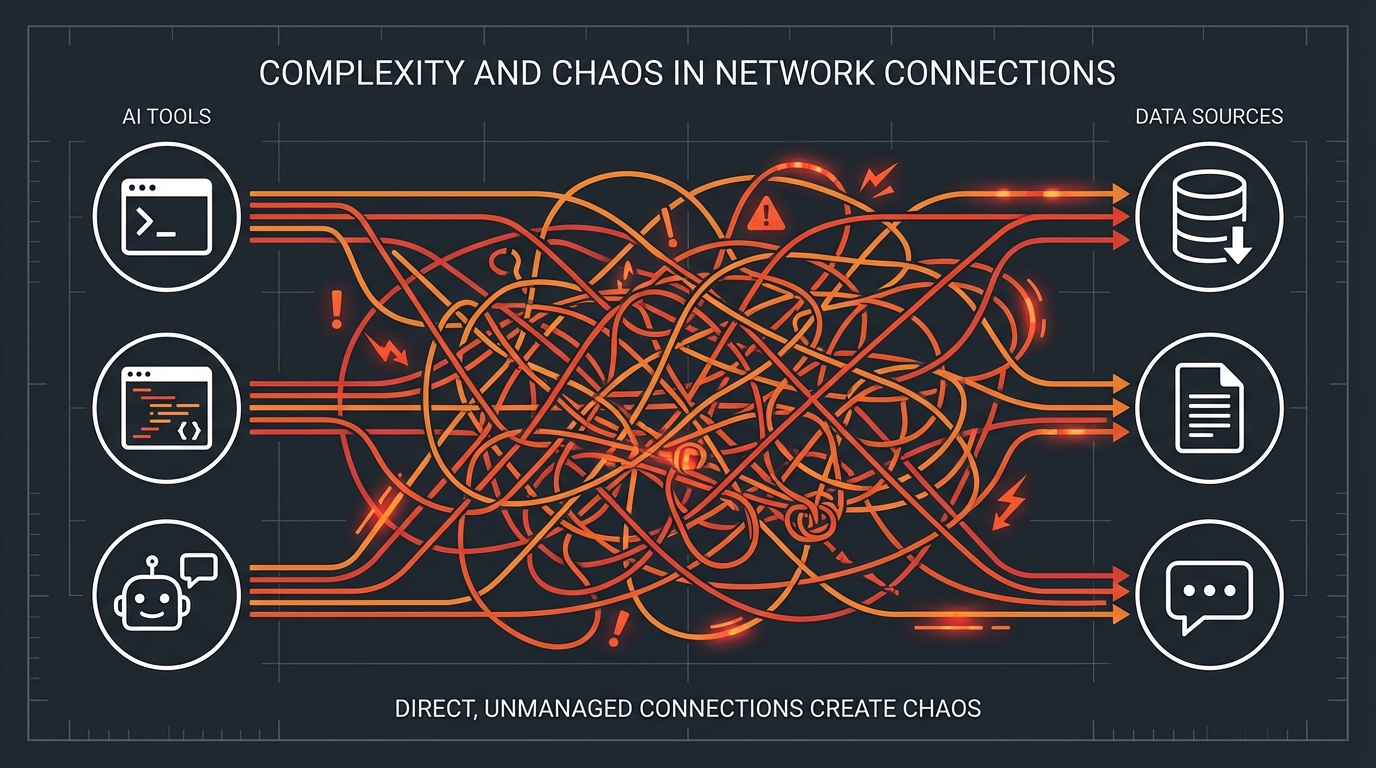

II. 问题本质:缺失的中间层 (The Missing Middle Layer)

如果我们画一张当前 MCP 生态的拓扑图,它是一个典型的 N x M 网状结构:N 个 AI 工具直接连接 M 个 MCP 服务。

图1: 缺乏网关时的 N x M 混乱连接 (AI Visualization)

图1: 缺乏网关时的 N x M 混乱连接 (AI Visualization)

- Cursor 直连 Postgres, Filesystem, Github

- Gemini CLI 直连 Postgres, Filesystem, Slack

- Claude Code 直连 Postgres, Filesystem, Linear

这种架构在短期内是可行的,但随着工具链的复杂度提升,其弊端暴露无遗:

数据孤岛 (Context Silos) AI 的记忆(Memory)和上下文(Context)被锁定在每个工具的私有存储中。Gemini 在 CLI 里学到的数据库 Schema知识,Cursor 一无所知。你的 AI 助手们虽然都在为你工作,但它们之间形同陌路。

安全黑洞 (Security Black Hole) 为了让三个工具都能访问数据库,你必须在三个地方填入数据库密码。一旦密码轮换,你需要更新三个配置文件。更糟糕的是,你很难知道此刻到底有哪个 AI 正在读取你的生产环境数据。

维护噩梦 (Maintenance Nightmare) 每个工具对 MCP 规范的支持程度不同。有的支持

stdio传输,有的只支持sse;有的支持动态资源订阅,有的不支持。作为开发者,你被迫去适配每个 Client 的怪癖。

这个场景似曾相识。在微服务架构普及之前,客户端也是直接连接后端的几十个服务。后来,我们发明了 API Gateway(如 Nginx, Kong)。

在 AI 工具链中,我们同样缺失了这样一个 Hub。

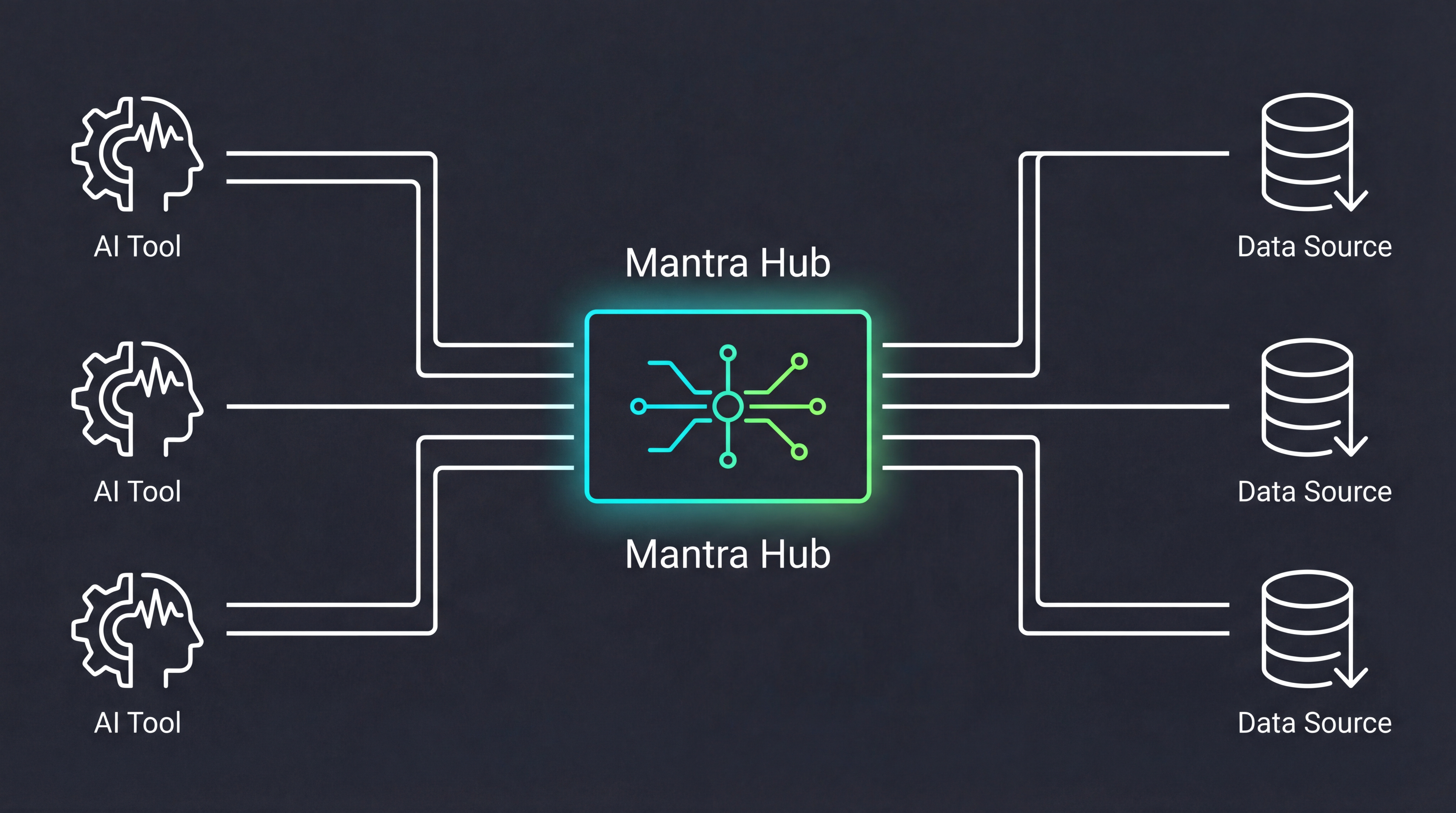

III. 解决方案:Mantra as an MCP Hub

为了打破这种碎片化的混乱,我们重新定义了 Mantra:它不再仅仅是一个使用 MCP 协议的客户端,它是一个本地 MCP Hub。

架构模式 (The Hub Pattern)

借鉴成熟的微服务架构,Mantra 在你的开发环境中建立了一个双向的"流量控制中心":

图2: Mantra Hub 模式:从 N x M 到 1 x M 的进化 (AI Visualization)

图2: Mantra Hub 模式:从 N x M 到 1 x M 的进化 (AI Visualization)

南向管理 (Southbound: Server Management) Mantra 负责连接并管理各种真实的 MCP Servers。无论是 Postgres、Slack 还是本地文件系统,它们都被统一注册在 Mantra 内部。Mantra 处理它们的生命周期:自动启动、健康检查、日志归集和错误重试。

北向服务 (Northbound: Unified Endpoint) 对外部 AI 工具(Cursor, Gemini CLI 等)来说,Mantra 就像是一个功能极其强大的"全能 Server"。这些工具只需配置一次指向 Mantra 的连接(通常是

localhost上的 SSE 或 Stdio 接口),就能瞬间获得所有已注册服务的访问能力。

关键特性

- 统一服务注册表 (Unified Registry):无论你是从

npx启动的临时工具,还是本地运行的 Rust 服务,只需在 Mantra 中配置一次。 - 上下文路由 (Context Routing):当 Cursor 请求查询数据库时,Mantra Hub 会识别出这是一个 Postgres 请求,并将其透明地路由到真实的 Postgres Server。

- 零侵入接管 (Non-invasive Takeover):Mantra 可以扫描你项目中已有的

.gemini/或.cursor/配置,将其"初始化"到 Hub 管理中,并将原有的配置文件重定向到 Hub Endpoint。

这种架构的改变,将复杂度从 N x M 降阶到了 1 x M。你只需要管理一个 Hub,就能服务于无限个 AI 助手。

IV. 核心价值:Re-centralize (重新中心化)

图3: Mantra Dashboard - 可观测性与集中治理 (Mockup)

图3: Mantra Dashboard - 可观测性与集中治理 (Mockup)

把配置统一到 Hub,不只是为了省事,它实际上改变了我们管理 AI 上下文的方式:

1. Write Once, Run Everywhere

这是开发者最直观的"爽感"来源。你在 Mantra 中配置好一个复杂的 Slack 搜索工具,配好环境变量,测试通过。从此以后,不论你在 VS Code 里写代码,还是在 Chrome 插件里聊天,甚至是在 Raycast 里触发快捷指令,只要这些工具连接到 Mantra Hub,它们就立刻拥有了搜索 Slack 的能力。

2. 不被特定的工具绑死 (Tool Agnostic)

目前的 AI 工具市场极其动荡:今天 Cursor 很火,明天 Claude Code 发布了新功能,后天 GitHub Copilot 可能会推出更强的协议。 如果你把所有的 MCP 配置和上下文逻辑都绑死在某个特定工具的私有路径下,迁移成本将非常高。通过 Mantra Hub,你实现了 "Context Layer" 与 "Frontend Layer" 的解耦。你可以自由尝试任何新出的 AI 工具,而你的"数字资产"(那些配置好的连接器和数据规则)始终保留在本地 Hub 中。

3. 可观测性与安全边界

当所有 AI 工具都通过 Mantra 访问本地数据时,你第一次拥有了上帝视角。

- 审计日志:哪个工具在几点几分偷看了我的

.env.production? - 细粒度控制:我可以允许 Cursor 读数据库,但只允许 Gemini CLI 读 Slack。

- 性能监控:哪个 MCP Server 响应太慢,导致 AI 生成卡顿?

当然,引入 Hub 并非没有代价。虽然本地 SSE 连接的延迟几乎可以忽略不计,但它确实增加了一个需要运行的后台进程。不过,相比于在三个不同的配置文件里维护三套相同的数据库密码,这种架构上的"增重"显然是值得的。

V. 结语:基础设施的觉醒

AI 辅助开发的演进,正在经历一个从"单体玩具"向"分层架构"转变的技术成熟路径。

未来的 AI 工具链不应该是由一堆互相竞争的黑盒组成的,而应该是透明、模块化且可管理的。正如 API 网关终结了微服务早期的连接混乱,MCP Hub 的出现,标志着 AI 上下文基础设施 (Context Infrastructure) 的觉醒。

通过将 MCP Hub 化,开发者正在重新拿回对工具链的主动权。在这种新范式下,配置不再是重复劳动的负担,而是可以持续积累的数字资产;安全也不再是不可见的黑盒,而是可以被审计和治理的边界。

这种架构的演进,才刚刚开始。

在下一篇文章中,我们将进入技术深水区,详细解析 Mantra 的 "透明代理接管 (Transparent Takeover)" 机制:它是如何自动扫描并无缝迁移你项目中既有的 MCP 配置,让你在保持原有习惯的同时,瞬间完成架构升级。

敬请期待:《Mantra MCP 系列 (2):透明代理接管,无缝统一你的项目上下文》。